“Dezvoltarea Inteligenței Artificiale ar putea însemna sfârșitul rasei umane. Inteligența Artificială se va dezvolta singură într-un ritm din ce în ce mai accelerat. Oamenii vor fi înlocuiți, pentru că sunt limitați de evoluția biologică lentă”.

Stephen Hawking

Suntem în 1956. În librăriile americane apare nuvela “The Minority Report” scrisă de Philip K. Dick. Celebrul autor își imaginase o lume complet automatizată, monitorizată video și plină de mașini autonome în care oamenii pot prezice producerea unei crime cu ajutorul unei mașinării cu inteligență proprie.

Acțiunea nuvelei, care în 2002 a fost ecranizată cu același nume într-un film cu Tom Cruise în rolul principal, se petrece în 2054. Deși suntem abia în 2021, numeroase elemente din scenariul science-fiction al nuvelei încep deja să fie familiare.

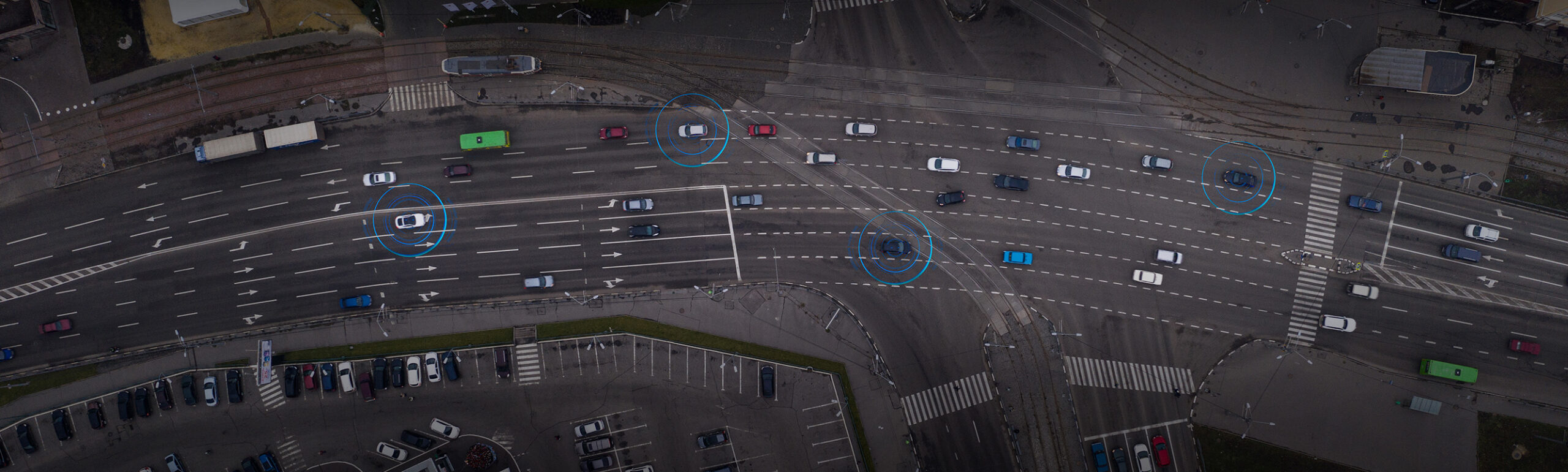

Sistemele de supraveghere video sunt o normalitate în marile orașe ale lumii, iar mașinile beneficiază de sisteme de asistență avansate care anticipează dezvoltarea viitoarelor vehicule autonome. Aproape orice gadget care apare pe piață, de la telefoane la aspiratoare, promite să ne ajute într-un fel sau altul printr-o serie de algoritmi software sofisticați.

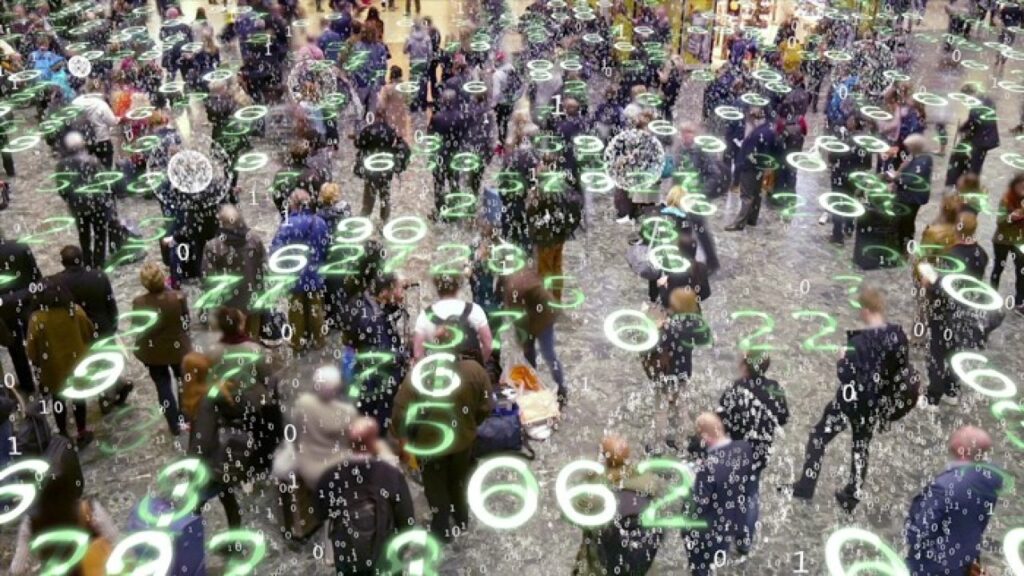

În China, în clasica tradiție a regimului politic din acest stat, totul pare dus la extrem. Cetățenii au “atașat” un așa-numit scor social determinat printr-o serie de algoritmi pe baza unor evenimente mai mult sau mai puțin subiective, cum ar fi facturile plătite cu întârziere sau amenzile de circulație. O valoare prea mică a scorului social poate avea ca efect interzicerea unor drepturi, cum ar fi călătoriile cu trenul sau avionul.

În același an în care Dick scria “The Minority Report”, cercetătorul John McCarthy menționa pentru prima oară noțiunea de Inteligență Artificială în cadrul unui workshop la Colegiul Dartmouth din Statele Unite. Este o noțiune complexă care include numeroase tehnologii, inclusiv cele folosite în prezent de China.

De altfel, “scorul social” dezvoltat de China a determinat Uniunea Europeană să-și manifeste îngrijorarea cu privire la modul în care poate fi utilizată Inteligența Artificială. Iar această îngrijorare este exprimată sub forma unei propuneri de legislații care prevede exact modul în care inteligența artificială poate fi utilizată în Europa. Este, dacă vrei, un soi de GDPR pentru Inteligența Artificială, iar legislația va avea un efect profund și asupra industriei auto. Mai exact, asupra tehnologiilor pe care le vor putea avea (sau nu) mașinile comercializate în blocul comunitar.

Ce este Inteligența Artificială?

Înainte să intrăm în detalii cu privire la regulile pregătite de Uniunea Europeană, este important să înțelegem concret ce presupune Inteligența Artificială (AI – Artificial Intelligence). Ei bine, poate vei fi surprins să afli că în prezent nu există o definiție universal acceptată pentru această noțiune.

Totuși, hai să încercăm împreună să dăm o definiție cât mai simplă și ușor de înțeles: Inteligența Artificială este o simulare a inteligenței umane prin utilizarea unor algoritmi avansați specifici programării calculatoarelor. Programarea noțiunilor de Inteligență Artificială are la baza trei funcții importante: sistemul AI trebuie să învețe anumite principii, să dezvolte un raționament pe baza căruia să adopte o serie de decizii și să fie capabil să-și corecteze greșelile.

Recunosc, este mai simplu să urmărești clipul de mai jos pentru a înțelege ce este și cum funcționează Inteligența Artificială:

Ce propune Uniunea Europeană?

În 21 aprilie 2021, Uniunea Europeană a publicat un draft pentru reglementarea modului în care pot fi folosite tehnologiile de Inteligență Artificială în Europa. Acesta este practic primul cadru legal din istorie la nivel global prin care se încearcă reglementarea tehnologiilor AI. Dacă nu știi ce carte să mai citești sau ai o pasiune pentru mediul juridic poți lectura cele 108 pagini ale documentului de reglementare pentru AI, care sunt disponibile atât în limba engleză, cât și în limba română.

Dacă nu, nu-i panică. Încerc aici să-ți explic foarte pe scurt despre ce este vorba. Concret, Uniunea Europeană a împărțit sistemele de Inteligență Artificială în funcție de riscurile pe care le prezintă acestea pentru drepturile fundamentale ale cetățenilor Uniunii. Iar riscurile asociate fiecărui sistem au fost împărțite în:

- risc inacceptabil: sistemele AI care reprezintă o amenințare la libertatea cetățeanului vor fi interzise. În această categorie intră, de exemplu, identificarea biometrică în spații publice, stabilirea unui “scor social” de către autorități (după modelul implementat deja în China) sau chiar jucării cu asistență vocală care încurajează un comportament periculos din partea copiilor;

- risc ridicat: sistemele AI care sunt folosite în anumite domenii considerate critice pentru activitatea umană. În această categorie intră, de exemplu, gestionarea migrației (verificarea actelor de călătorie), justiția (stabilirea verdictului unui proces), serviciile publice și private esențiale (obținerea unui credit în funcție de un algoritm AI), ocuparea locurilor de muncă (analizarea CV-urilor prin sisteme AI) sau infrastructura critică precum sistemele de alimentare cu energie sau transporturile. Toate sistemele încadrate la risc ridicat trebuie să respecte o serie de obligații stricte;

- risc limitat: în principiu, în această categorie intră roboții software utilizați în serviciile de chat de numeroase companii, în special pentru customer service (Bună, Ana!). În astfel de cazuri, utilizatorii trebuie informați explicit că discută cu un robot.

- risc minim: cele mai multe sisteme AI vor fi încadrate în această categorie, care nu necesită niciun fel de reglementare strictă legală. De exemplu, la categoria de risc minim vor fi incluse filtrele antispam pentru mail sau sistemele AI din jocurile video.

Iată și câteva opinii ale unor parlamentari europeni pe marginea acestui subiect:

Ce treabă are AI-ul cu industria auto?

Mi-am asumat riscul de a te plictisi cu astfel de detalii birocratice pentru a înțelege mai bine modul în care noul regulament propus de Uniunea Europeană va influența industria auto. Probabil că nu te-ai gândit niciodată la asta, dar aproape toate sistemele de asistență, de siguranță sau de confort pe care le ai pe mașina ta cu care mergi la birou și îți faci concediul regulamentar în Grecia au la bază senzori și diverse sisteme care pot fi asociate cu ușurință cu Inteligența Artificială.

Vrei exemple? Hai să vedem:

- asistentul vocal pe care îl întrebi cum este vremea la destinație, chiar dacă știi cât de imprecise sunt prognozele meteo;

- sistemul de monitorizare a atenției la volan care detectează că dormi (în funcție de cât de des clipești) sau că nu te mai oprești odată din swipe-ul de pe Facebook (după poziția capului);

- sistemul de climă care determină și activează un set predefinit de setări pentru temperatură în momentul în care urci la volan. E bine la răcoare, nu-i așa?

- sistemul de infotainment care îți sugerează anumite piese muzicale în funcție de tipul de muzică pe care ai ascultat-o anterior. Și care insistă să-ți propună Dani Mocanu indiferent dacă îți place sau nu;

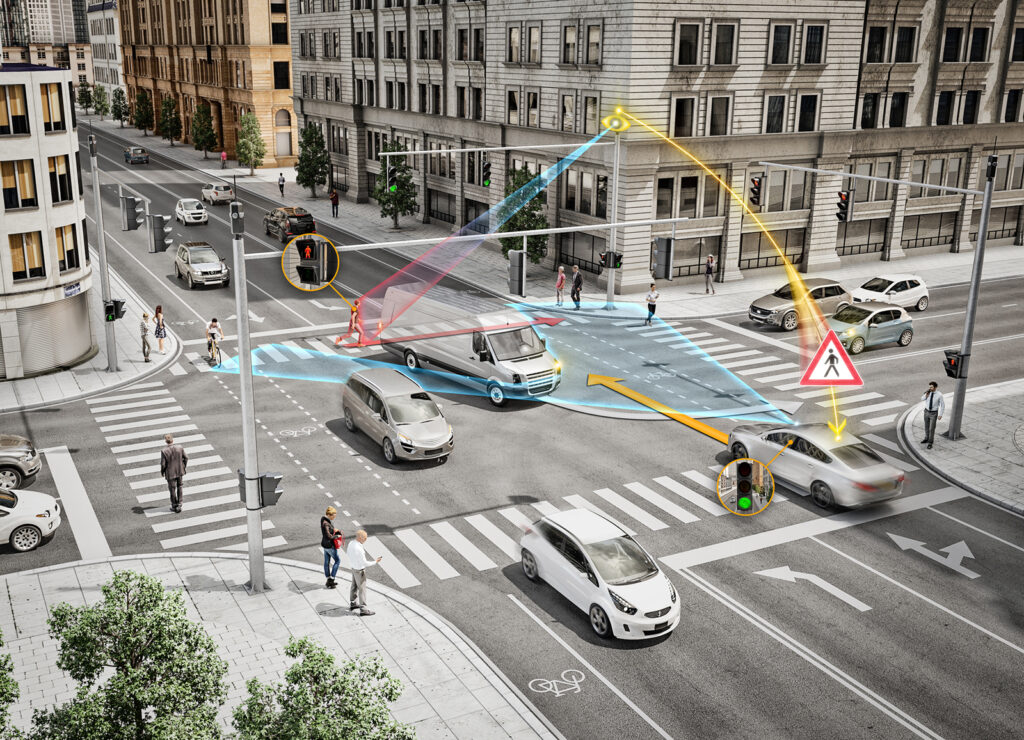

- sistemul de frânare automată de urgență (AEB) care recunoaște diverse obstacole și aplică presiune pe frâne pentru a evita producerea unui accident;

- sistemul de tip Cruise Control Adaptiv care determină prezența unui vehicul în față pentru a ajusta viteza ta de deplasare.

Într-un fel sau altul, toate aceste sisteme utilizează Inteligență Artificială, iar noul regulament al Uniunii Europene le va clasifica cel mai probabil la categoria de risc ridicat. Asta înseamnă că sistemele implementate de constructori pe mașina va trebui să respecte o serie de cerințe foarte clare, care vor fi detaliate ulterior de Uniunea Europeană.

Ce solicită constructorii auto?

Pentru a putea vinde mașini în Uniunea Europeană, constructorii auto trebuie să respecte numeroase cerințe de natură tehnică. Asociația Europeană a Constructorilor de Automobile (ACEA) și-a exprimat deja acordul pentru stabilirea unui grad de risc pentru sistemele de Inteligență Artificială, însă solicită ca noile reguli să fie integrate în actuala legislație tehnică pentru aprobarea vehiculelor.

ACEA atrage atenția că, în caz contrar, există riscul dublării anumitor standarde sau chiar a apariției unor neconcordante între respectarea cerințelor tehnice și cele legate de sistemele AI, elemente care ar încetini inovația și ar îngreuna adoptarea pe scară largă a soluțiilor de Inteligență Artificială.

În plus, ACEA insistă că Uniunea Europeană trebuie să ia în considerare gradul de automatizare și comportamentul vehiculului (de exemplu, cerințele tehnice pentru validarea unui sistem), în detrimentul tehnologiei utilizate pentru implementarea sistemului respectiv.

Avertismentul furnizorilor: “Nu împiedicați inovația!”

Între timp, Asociația Europeană a Furnizorilor din Industria Auto (European Association of Automotive Suppliers – CLEPA) avertizează oficialii europeni că reglementarea prea strictă a utilizării tehnologiilor de Inteligență Artificială ar putea conduce la blocarea sau reducerea inovațiilor din industria auto.

În sprijinul afirmațiilor, CLEPA oferă și câteva exemple concrete, cum ar fi sistemul care permite monitorizarea stării de oboseală a șoferilor. “Unele aplicații legate de siguranță, cum ar fi monitorizarea atenției șoferului, pot scana fețele umane, dar nu ar trebui considerate tehnologie de recunoaștere facială, întrucât nu pun în pericol drepturile fundamentale”, explică CLEPA.

Și nu doar atât. Inclusiv camerele video și senzorii care detectează pietonii pentru a permite frânarea automată de urgență ar putea fi considerate un risc prea mare din perspectiva Uniunii Europene. “Astfel de aplicații de inteligență artificială pot include de asemenea detectarea pietonilor și a intențiilor acestora, dar este posibil să anonimizam datele pentru a asigura intimitatea persoanelor”, mai precizează CLEPA.

În tot acest context, CLEPA afirmă că datele sunt esențiale pentru dezvoltarea sistemelor de siguranță și de asistență pentru mașini, motiv pentru care recomandă Uniunii Europene să nu adopte măsuri puternic restrictive care ar limita utilizarea acestora.

“Fără date, dezvoltatea Inteligenței Artificiale și a altor aplicații digitale este imposibilă. De exemplu, sistemele de Machine Learning învață să recunoască tipare sau anomalii prin analiza datelor. Cu cât există mai multe date, cu atât sistemele pot deveni mai precise. Datele reprezintă sângele Inteligenței Artificiale, ceea ce înseamnă că accesul și gestionarea datelor sunt fundamentale”.

În sprijinul afirmațiilor, CLEPA scoate în evidență că numeroasele sisteme de asistență și de siguranță dezvoltate până în prezent sunt esențiale pentru ca Uniunea Europeană să-și îndeplinească obiectivul ambițios ca cel târziu în 2050 să nu mai existe victime în accidente rutiere. “Este extrem de important să nu împiedicăm inovația într-un mod inutil. Cerințe dificile ar pune în pericol dezvoltarea unor vehicule mai sigure, dar și propriul obiectiv al Uniunii Europene de a elimina victimele accidentelor rutiere până în 2050. Cerințele de reglementare ar trebui să rămână întotdeauna proporționale cu posibilul risc”, afirmă Sigrid de Vries, secretarul general al CLEPA.

Elefantul din cameră

Referința la obiectivul Uniunii Europene privind reducerea la zero a victimelor accidentelor rutiere până în 2050 aduce în discuție unul dintre cele mai sensibile subiecte când vine vorba despre Inteligența Artificială: cine este vinovat în cazul în care o mașină complet autonomă produce un accident? Șoferul, care în acest caz joacă practic rol de pasager, sau producătorul mașinii? Este un subiect pentru care nici măcar noul regulament pentru utilizarea Inteligenței Artificiale nu aduce mai multă lumină. Cel puțin pentru moment.

Teoretic, avem deja un exemplu în care o persoană a încetat din viață în urma unui accident în care a fost implicată o mașină autonomă: Elaine Herzberg nu a supraviețuit după ce a fost lovită în 18 martie 2018 de un Volvo XC90 echipat cu sisteme autonome dezvoltate de serviciul de ride-hailing Uber.

Inițial, autoritățile americane s-au limitat să afirme că nu au identificat o “cauză probabilă” a accidentului, însă după doi ani de investigații s-a tras o concluzie. Sau mai multe.

În primul rând, compania Uber nu a fost considerată vinovată de producerea accidentului, în ciuda faptului că a dezvoltat sistemele autonome de pe Volvo XC90. În al doilea rând, șoferul de “back-up” al mașinii, Rafael Vasquez, a fost acuzat de ucidere din culpă, întrucât cercetările au indicat că accidentul a fost provocat de o eroare umană. Mai exact, camera on-board a arătat că Vasquez se uita în jos în secundele premergătoare accidentului pentru că privea un episod din serialul “The Voice” în timp ce vehiculul se deplasa cu 63 km/h. Practic, concluzia a fost că Vasquez avea timpul necesar pentru a reacționa și a frâna pentru a evita un accident.

Accidentul s-a produs în Statele Unite, prima țară din lume care a publicat (în 2016) un ghid oficial pentru circulația mașinilor autonome. Totuși, este interesant de menționat că, dacă accidentul ar fi avut loc în Germania, este posibil ca verdictul să fi fost altul.

Statul european a stabilit în 2017 că șoferul este obligat să preia controlul mașinii autonome în cazul în care aceasta îi transmite explicit acest lucru. Astfel, șoferul este responsabil pentru un accident în cazul în care controlează mașina. În schimb, dacă accidentul se petrece în timp ce mașina este condusă de sistemul autonom, vinovat este constructorul.

De altfel, cu câțiva ani înainte de reglementările intrate în vigoare în Statele Unite și Germania, Volvo anunța încă din 2015 că își va asuma responsabilitatea juridică în cazul unui accident petrecut într-un moment în care sistemele autonome controlează mașina.

În tot acest context, oficialii CLEPA menționează că este practic imposibil ca un operator uman să țină pasul în timp real cu toate deciziile pe care le ia un sistem de Inteligență Artificială. Concret, CLEPA susține că o persoană prezentă într-o mașină autonomă nu poate înțelege pe deplin motivele pentru care o mașină autonomă ia anumite decizii cu privire la maniera de condus.

“Întrucât cele mai multe decizii sunt luate în timp real, nu este posibil să monitorizăm fiecare decizie în parte a unui vehicul autonom. Prin urmare, cerința existenței unei supravegheri umane ar trebui privită ca o verificare prealabilă a logicii pe care se vor baza deciziile pe care le vor lua vehiculele autonome”.

Dacă stăm strâmb și judecăm drept, asta înseamnă că sistemele de Inteligență Artificială ar trebui să-și “asume” răspunderea în cazul unui accident. Cu toate acestea, tot CLEPA susține, în mod oarecum ciudat, contrariul.

“CLEPA nu este în favoarea unui concept cu privire la responsabilitatea generală a furnizorului de sisteme AI, nici măcar în cazul sistemelor considerat cu risc ridicat. Totuși, pot fi luate în considerare anumite excepții, cum ar fi forța majoră sau atacurile cibernetice”, menționează CLEPA în raportul oficial.

Întrucât documentul oficial de 108 pagini al Uniunii Europene nu aduce clarificări concrete, este prematur să anticipăm cum va fi afectată industria auto de o astfel de legislație. Ca de fiecare dată în astfel de situații, este important să ascultăm cât mai multe opinii argumentate. Și, dacă ai avut răbdare până aici, merită să afli și ce spun oamenii care conduc două dintre cele mai importante companii de tehnologie din lume, nu-i așa?

Începem cu Eric Schmidt, fostul CEO al Google, care are o poziție tranșantă. Acesta afirmă că proiectul Uniunii Europene reprezintă un “dezastru”, întrucât “Inteligența Artificială este prea recentă. Mai întâi trebuie să o inventăm”. Îl ajută cineva cu o viză de China?

O părere diametral opusă are Brad Smith, președintele Microsoft. “Dacă nu adoptăm legi care să apere populația, tehnologia va prelua controlul și va fi foarte dificil să recuperăm în acel moment. Îmi amintesc mereu de cartea “1984” scrisă de George Orwell, în care guvernul poate vedea în permanență ce fac și ce vorbesc oamenii. Nu s-a întâmplat în 1984, dar dacă nu suntem atenți se poate întâmpla în 2024”.

Și, așa cum am văzut deja, astfel de lucruri se întâmplă, la o scară ceva mai mică, în China.

De altfel, lucrurile se mișcă, într-un fel sau altul, și în Statele Unite ale Americii. Agenția națională pentru siguranța traficului, cunoscută sub acronimul NHTSA (National Highway Traffic Safety Administration) a emis în luna iunie un ordin prin care constructorii auto sunt obligați să raporteze toate accidentele în care au fost implicate mașini care aveau diverse sisteme de asistență activate.

Ordinul se aplică inclusiv pentru sisteme devenite deja banale precum Lane Departure Warning, care avertizează șoferul că a părăsit banda de circulație. În plus, NHTSA promite că toate datele colectate vor fi făcute publice. Cercetătorii din industria auto au salutat inițiativa, însă nu sunt sigur că Elon Musk a desfăcut vreo sticlă de șampanie cu această ocazie.

Ce urmează?

Pe scurt, urmează o lungă perioadă de dezbateri în Parlamentul European și, cel mai probabil, o serie de modificări mai mult sau mai puțin importante asupra textului final.

Nu este clar când va fi adoptată legislația finală, însă ca punct de reper putem lua celebrul GDPR. Regulamentul pentru Protecția Generală a Datelor a fost anunțat inițial în 2014, a fost adoptat oficial în 2016 și a intrat în vigoare în 2018, adică la o distanță de 4 ani. Nu este exclus ca regulamentul pentru sistemele de Inteligență Artificială să aibă nevoie de un interval și mai mare înainte de aprobarea finală, întrucât tehnologiile sunt mai complexe. Și mai greu de înțeles pentru mulți dintre parlamentarii europeni.

Până atunci nu ne rămâne decât să ne bucurăm în continuare de plăcerea de a conduce mașini care nu sunt încă complet autonome. Cu excepția cazului în care ne aflăm pe Valea Prahovei într-o zi de sâmbătă, desigur.